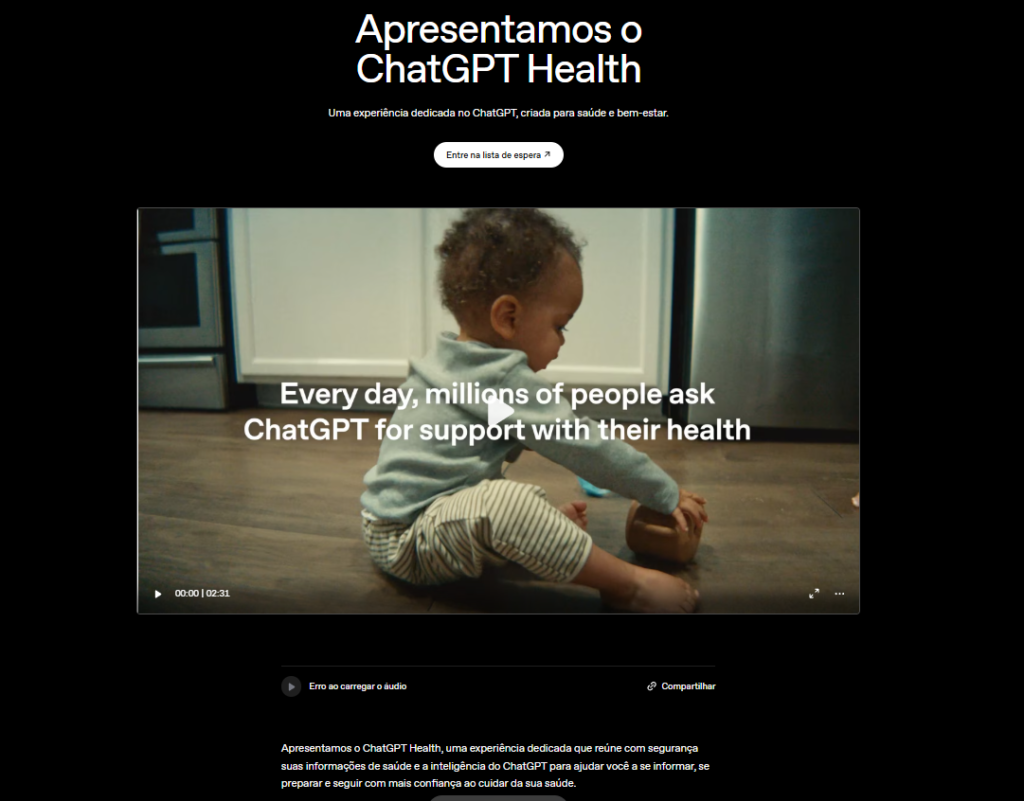

A OpenAI anunciou recentemente uma nova iniciativa do ChatGPT voltada especificamente para saúde e medicina, o ChatGPT Health. O movimento ocorre em um momento em que o uso de inteligência artificial para esclarecer dúvidas médicas já é uma realidade para milhões de pessoas — muitas vezes sem qualquer mediação ou critério clínico.

A proposta, segundo a empresa, é criar um ambiente mais seguro e estruturado para lidar com informações de saúde, com atenção especial à privacidade dos dados e ao uso responsável da tecnologia.

O uso de Inteligência Artificial tem crescido exponencialmente em diversos segmentos da sociedade e na medicina não poderia ser diferente. Assim como a sociedade se torna mais tecnologica, a área médica tem buscado maneiras de evoluir também e trazer mais dinamismo e processos mais eficazes. – Raphael Silva, co-founder do Instituto Limiares.

Mas o que exatamente muda com esse anúncio? E qual é o impacto real para médicos, profissionais de saúde e para o ensino médico?

Uma resposta ao uso crescente de IA em saúde

Ferramentas de inteligência artificial já vêm sendo utilizadas, de forma informal, para interpretação de exames, esclarecimento de sintomas e consulta a diretrizes. O problema é que, até agora, isso acontecia em ambientes genéricos, sem separação clara entre dados sensíveis e outras interações.

A iniciativa da OpenAI surge como uma tentativa de organizar esse uso, oferecendo uma versão do ChatGPT preparada para lidar com informações médicas de maneira mais cuidadosa, transparente e contextualizada.

O que é o ChatGPT com foco em saúde?

Segundo a OpenAI, a ferramenta não foi desenvolvida para realizar diagnósticos ou substituir consultas médicas. O objetivo é auxiliar na compreensão e organização de informações de saúde, tanto para pacientes quanto para profissionais.

Entre as aplicações destacadas estão o apoio à interpretação de exames laboratoriais e dados clínicos, organização de históricos de saúde e informações dispersas, a contextualização de diretrizes e consensos médicos, a melhoria da comunicação entre médico e paciente, entre outros. Trata-se, portanto, de um sistema de apoio à informação — e não de decisão clínica.

O que a tecnologia não faz

A empresa reforça alguns limites importantes:

-

não fornece diagnóstico médico

-

não prescreve tratamentos

-

não substitui avaliação clínica presencial

-

não toma decisões terapêuticas

Esses pontos têm sido destacados para evitar interpretações equivocadas e uso indevido da ferramenta.

Um “copiloto” para o raciocínio clínico

Especialistas têm descrito esse tipo de tecnologia como um copiloto cognitivo. A ideia é que a inteligência artificial ajude a organizar grandes volumes de informação, reduzindo ruído e facilitando o raciocínio — especialmente em cenários complexos.

Na prática, o profissional de saúde continua sendo responsável por formular hipóteses diagnósticas, avaliar riscos e benefícios, considerar o contexto individual do paciente e tomar decisões clínicas. A IA atua apenas como apoio informacional.

Privacidade e segurança dos dados

Um dos principais pontos do anúncio é a criação de camadas adicionais de proteção para dados de saúde. A OpenAI afirma que conversas relacionadas à saúde ficam isoladas de outros usos e que há maior controle sobre dados sensíveis, sendo que o seu o uso depende de consentimento explícito. A empresa també informa que existe separação clara entre apoio informacional e outras funcionalidades da plataforma.

Ainda assim, especialistas ressaltam que o uso institucional dessas ferramentas exige avaliação jurídica, ética e regulatória, especialmente em ambientes clínicos e educacionais.

Possíveis impactos no ensino médico

No campo da educação em saúde, o potencial é significativo. Ferramentas desse tipo podem apoiar o aprendizado baseado em casos clínicos, ajudar estudantes e residentes a estruturar raciocínio clínico, facilitar a revisão de conceitos e diretrizes, complementar o ensino tradiciona, dentre outros benefícios.

Como qualquer IA, os dados ali expressados ajudam, mas precisam ser checados. Logo, o uso deve ser supervisionado e metodológico, evitando que a tecnologia substitua o processo formativo essencial da medicina.

A leitura do Instituto Limiares

Para o Instituto Limiares, o anúncio reforça uma tendência já em curso: a incorporação gradual da inteligência artificial ao ecossistema da saúde. É exatamente por isso que em 2026 criamos o Tech Limiares, braço dedesenvolvimento tecnológico que reúne a expertise adquirida nos Serviços Limiares e conhecimento do Ensino Limiares para aplicar em aplicações e novas tecnologias que auxíliam de A a Z na vida de quem faz a saúde.

Para os especialistas do Instituto está claro que a tecnologia pode contribuir para maior clareza na análise de dados clínicos, porém o raciocínio médico continua sendo central e o uso responsável depende de método, senso crítico e formação adequada. A empresa acompanha esse movimento com atenção, destacando a importância de alinhar inovação tecnológica à prática clínica real.

Um movimento que exige entendimento — não apenas adesão

A chegada de ferramentas de inteligência artificial ao campo da saúde não é mais uma hipótese futura, mas, sim, um processo em andamento. Entender como funcionam, quais são seus limites e como podem ser usadas de forma ética e responsável será cada vez mais relevante para médicos e profissionais de saúde.

Mais do que adotar novas tecnologias, o desafio está em integrá-las com critério ao raciocínio clínico e ao cuidado com o paciente.

📌 Leia mais no blog do Instituto Limiares

Seguimos acompanhando e analisando os impactos da tecnologia no ensino e na prática médica, sempre com foco em método, responsabilidade e clareza.

👉 Acesse nossos conteúdos e acompanhe essa discussão de forma aprofundada.